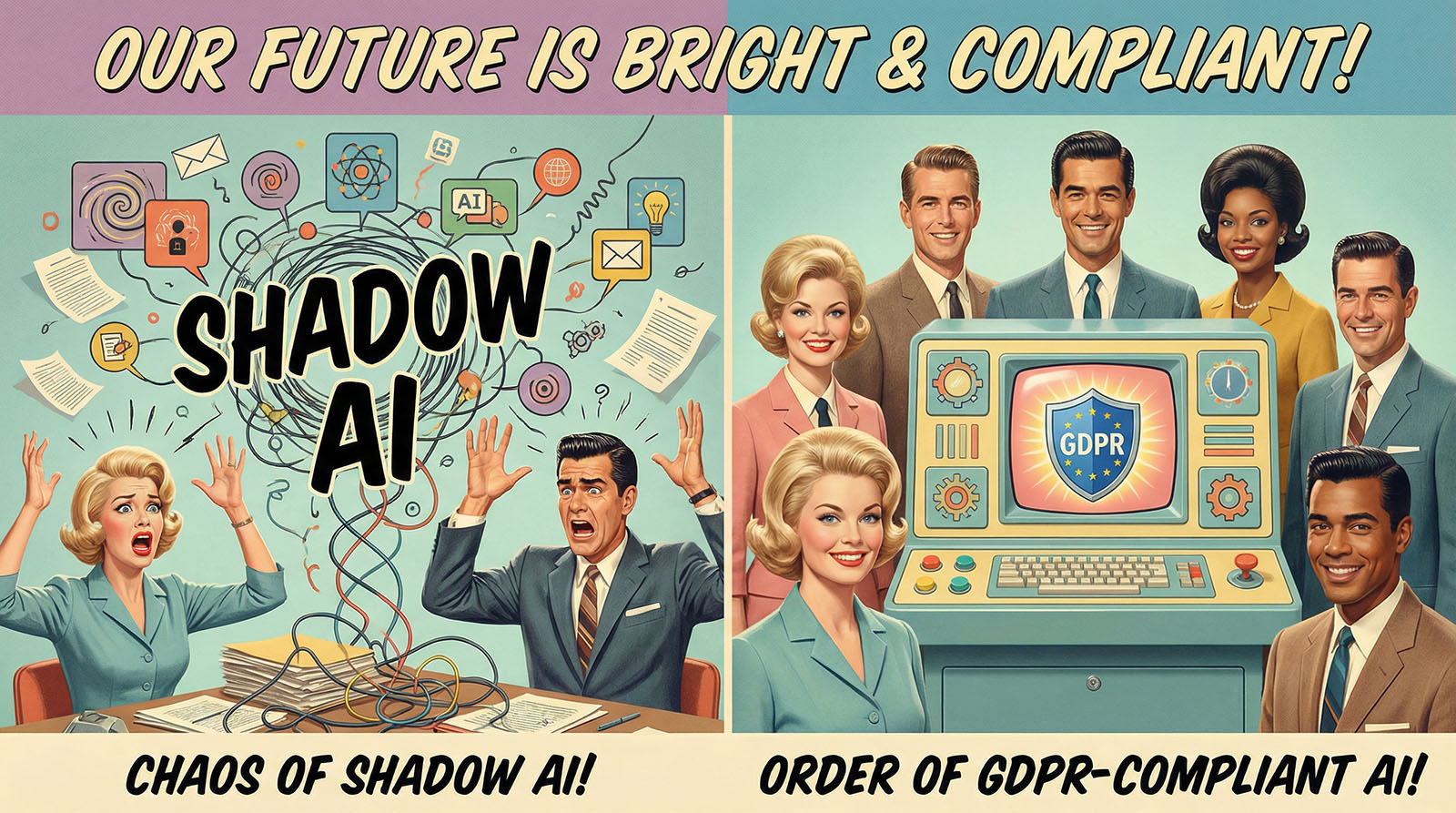

Det är mycket troligt att någon på ditt företag har använt AI under en längre tid - utan några riktlinjer, godkännanden eller AV-avtal.

Inom marknadsföring putsas texter med ChatGPT, inom försäljning hamnar kunddata i prompter, inom utveckling dubbelkollas kod med hjälp av AI-verktyg. Det är välmenande, men ur ett GDPR, EU:s AI-förordning och företagens efterlevnad det här är en tickande bomb: skugg-AI.

Samtidigt skulle det vara absurt att förlita sig på produktivitetsvinsterna i moderna Stora språkmodeller (LLM) att klara sig utan. Konsten ligger i detta, AI och dataskydd med ett tydligt ramverk som möjliggör innovation och begränsar riskerna.

Som Certifierad AI-expert (MMAI® Business School-certifikat, Academy4AI) och framtida medlem i German AI Association Jag stödjer företag i just denna skärningspunkt mellan teknik, juridik och styrning - och som WooCommerce-specialist & WordPress-utvecklare för små och medelstora företag och industrin Jag känner mycket väl till det praktiska perspektivet från projekt.

Den här artikeln handlar om det:

- såsom DSGVO och EU:s AI-förordning (AI-lagen) arbeta tillsammans,

- vilka risker som verkligen är relevanta när man använder ChatGPT, Claude, Gemini & Co,

- som Praktiska regler för dataskyddsvänlig AI-användning bör införas,

- och varför en plattform som InnoGPT är ett spännande alternativ för dig som vill ge dina team en GDPR-kompatibel AI-miljö skulle vilja tillhandahålla.

I den här artikeln delar jag med mig av mitt professionella perspektiv som certifierad AI-expert. Den här artikeln ersätter dock inte individuell juridisk rådgivning. Om du behöver en bindande bedömning av dataskyddet rekommenderar jag att du rådgör med en kvalificerad advokat eller ett dataskyddsombud.

1. Den bindande rättsliga ramen 2025: GDPR + EU:s AI-förordning (AI-lagen)

1.1 GDPR förblir grunden för alla personuppgifter

Så snart du Personuppgifter till AI-system - oavsett om det är för utbildning, för att svara på frågor eller för analys - så gäller GDPR. Du måste bland annat

- en Rättslig grund i enlighet med artikel 6 i GDPR,

- Öppenhet gentemot de drabbade,

- Minimering av data notera,

- genomföra tekniska och organisatoriska åtgärder (TOM),

- och om nödvändigt. Konsekvensbedömningar avseende dataskydd (DPIA) utföra. (Handelsblatt Live)

År 2024 publicerade den tyska dataskyddskonferensen (DSK) en detaljerad Vägledning „AI och dataskydd“ publiceras. Det klargörs att alla som väljer och använder AI-applikationer är ansvariga för att säkerställa att detta val överensstämmer med dataskyddsbestämmelserna - inklusive valet av leverantör, dataflöden och konfiguration. (Konferens om dataskydd)

Den EDPB (Europeiska dataskyddsstyrelsen) har med sin ChatGPT-arbetsgruppen tog också upp specifika frågor om lagligheten av webbskrapning, transparens och noggrannhetskrav för LLM. (EDPB)

Kort sagt: Även om AI är nytt När det gäller dataskyddslagstiftning är det inte ett rättsligt vakuum.

1.2 EU:s AI-förordning (AI Act): Riskbaserad och styrningsdriven

Med EU:s AI-förordning (förordning (EU) 2024/1689) 2024 antog EU världens första omfattande rättsliga ramverk för AI-system. AI-lagen har varit 1 augusti 2024 och bygger på ett riskbaserat tillvägagångssätt: från minimal risk till begränsad risk och vidare till AI med hög risk och förbjudna metoder. (EUR-Lex)

Viktiga punkter:

- Några Förbud mot vissa AI-metoder (t.ex. vissa former av manipulativa system) och krav på AI-kompetens / AI-läskunnighet har varit i kraft sedan 2 februari 2025. (Lag om artificiell intelligens EU)

- Majoriteten av åtagandena - särskilt för AI med hög risk - håller gradvis på att 2 augusti 2026 med ytterligare konkretiseringar och riktlinjer från EU-kommissionen och den nya Europeiska AI-kontoret. (AI Act Service Desk)

- AI-lagen skapar bland annat krav på Riskhantering, datakvalitet, loggning, teknisk dokumentation, transparens, mänsklig tillsyn och styrningsstrukturer. (EUR-Lex)

Detta diskuteras för närvarande inom EU, att förlänga vissa skyldigheter för högrisk-AI till 2027, för att ge företagen mer tid för implementering. Från och med idag (11 december 2025) är detta ett politiskt förslag som fortfarande måste gå igenom lagstiftningsprocessen. (Reuters)

Viktigt för dig:

GDPR förblir fullt tillämplig, AI-lagen kompletterar dessa. I händelse av tvivel:

„AI-lagen reglerar vad ett AI-system får göra - GDPR reglerar detta, som du är behörig att hantera personuppgifter.“ (Handelsblatt Live)

1.3 AI-kompetens och styrningsskyldigheter: Varför företag behöver påvisbara AI-kunskaper efter 2025

För första gången ger EU:s AI-förordning ett tydligt ramverk för företagens organisatoriska ansvar, som använder AI-system - oavsett om de utvecklar egna modeller eller använder externa verktyg.

Två punkter har varit särskilt viktiga sedan 2025:

AI-läskunnighetsskyldighet (artikel 4 i AI-lagen) - tillämplig sedan februari 2025

Företag som tillhandahåller eller driftsätter AI-system („leverantörer“ och särskilt „driftsätter“) måste säkerställa att deras anställda har en Tillräcklig nivå av AI-expertis egen. I praktiken innebär detta

- Medarbetarna måste förstå hur AI fungerar i princip, var riskerna finns och hur de kan arbeta med det på ett säkert sätt.

- Företagen måste tillhandahålla utbildning, medvetandehöjande åtgärder och interna riktlinjer.

- Dessa åtgärder måste dokumenteras på ett sådant sätt att de är verifierbara i samband med ansvarsutkrävande.

Med andra ord..:

„Använda AI“ har varit oskiljaktigt från „Demonstrera AI-expertis“ sedan februari 2025.

AI-styrning - relevant för AI för allmänna ändamål sedan augusti 2025

När förordningarna om AI för allmänt ändamål (GPAI) börjar tillämpas i augusti 2025 gäller ytterligare organisatoriska krav - särskilt för leverantörer, men indirekt även för företag som använder sådana system produktivt:

- Strukturerad dokumentation av de modeller som används,

- Övervakning och loggning av användning,

- Processer för incidenthantering, risker och klagomål,

- tydliga roller och ansvarsområden vid användning av AI.

Även om den fullständiga kanon av skyldigheter för högrisk-AI inte träder i kraft förrän 2026/2027, är det tydligt:

Utan ett AI-styrningskoncept - dvs. dokumenterat ansvar, riktlinjer, processer och utbildning - kommer det att bli allt svårare för företag att på ett trovärdigt sätt visa att de följer AI Act och GDPR.

2. Vad tillsynsmyndigheterna faktiskt säger om AI och LLM:er

För att göra det mer konkret tar vi en kort titt på tre viktiga källor:

- DSK-vägledning „AI och dataskydd“ (2024) - ger företag och myndigheter kriterier för att välja och använda AI-system: Ändamålsbegränsning, rättslig grund, uppgiftsminimering, öppenhet, orderbehandling, tekniska och organisatoriska åtgärder. (Konferens om dataskydd)

- Rapport från arbetsgruppen för EDPB ChatGPT (maj 2024) - belyser bland annat:

- hur utbildning om webbskrapning av personuppgifter ska bedömas juridiskt,

- vilka skyldigheter till insyn och information som finns gentemot användarna,

- vilka krav som ställs på att LLM-svaren är korrekta och rättvisa. (EDPB)

- Nationella faktablad, t.ex. HWR Berlin / dataskyddsombud - visa mycket specifikt vilka data som genereras när generativ AI används och hur denna användning kan utformas på ett dataskyddsvänligt sätt (t.ex. inga direkta identifierare, pseudonymisering, inga känsliga data i fritt tillgängliga verktyg). (Dataskydd HWR Berlin)

Budskapet är detsamma överallt:

- Princip: Lägg in så lite personuppgifter som möjligt i AI-system.

- Företagen behöver tydliga regler, vilka verktyg som får användas och hur.

- „Att “bara prova på" är inte ett lagligt skäl.

3. Typiska risker: Hur skugg-AI uppstår i företaget

Några typiska situationer som jag ser om och om igen:

- Marketing laddar kunddata (t.ex. CRM-export) i valfri AI-webbapp för att „snabbt skapa segment“.

- HR har anställningsavtal eller ansökningar som bedöms av ChatGPT - inklusive fullständiga personuppgifter.

- Försäljning kopierar kompletta e-posthistoriker med personlig information till LLM:er för att formulera „bättre svar“.

- Specialistavdelningar använder kostnadsfria LLM-verktyg utan företagskonto, utan AV-avtal och utan att veta var uppgifterna behandlas.

Ur ett dataskyddsperspektiv är detta flera problemområden:

- oförklarlig Roller och ansvarsområden (Styrenhet/processor),

- möjligt Överföringar till tredje land (t.ex. USA),

- oklart Lagring och utbildning i användning av data,

- Saknas eller är otillräcklig Information till berörda personer.

Det är just dessa fall som tillsynsmyndigheterna för dataskydd har fokuserat alltmer på under de senaste månaderna - inklusive kortsiktiga begränsningar och granskningar av enskilda leverantörer. (StreamLex)

4. 10 grundläggande regler: Använda LLM:er på ett dataskyddsvänligt sätt (ensam och i ett team)

Oavsett om du är en enskild näringsidkare eller ett medelstort IT-företag - följande regler är till stor hjälp i praktiken för att LLM:er GDPR-vänliga att använda:

- Inga känsliga personuppgifter i konsumentkonton

Hälsouppgifter, särskilda kategorier i enlighet med artikel 9 i GDPR, konfidentiell information om anställda, interna avtal etc. hör inte hemma i fritt tillgängliga AI-frontends. (Dataskydd HWR Berlin) - Pseudonymisera eller anonymisera när så är möjligt

I stället för „Max Mustermann, IBAN, projekt XY hos kund Z“ är det bättre att säga: „Kund A, budget B, projekt inom maskinteknik, exportland D“. - Tydlig verktygsstrategi: skilja mellan privat och professionellt

Inget „jag använder bara mitt privata ChatGPT-konto“. Definiera auktoriserade verktyg - och om du är osäker, blockera problematiska domäner på företagets proxy. (NRW:s statliga databas) - Skapa en företagspolicy („AI-policy“)

Kort, begripligt, praktiskt: Vilka verktyg är tillåtna? Vilka data är tillåtna? Vem är kontaktperson för frågor? Idag är en AI-riktlinje inte längre något som är „bra att ha“, utan en central del av AI-styrningen. - Förtydliga rättslig grund

I företaget kommer du ofta att förlita dig på berättigade intressen (artikel 6.1 f i GDPR), fullgörande av avtal eller, i förekommande fall, samtycke. Det är viktigt att ha korrekt dokumentation i Förteckning över behandlingsaktiviteter. (Konferens om dataskydd) - Kontrollera DSFA - särskilt för känsliga scenarier

Om AI-system ingriper massivt i affärsprocesser eller innehåller profileringselement, kan en Konsekvensbedömning av dataskydd ofta obligatoriska. (Konferens om dataskydd) - Loggning och spårbarhet

Vem använder vilket system till vad? Loggning är inte bara en IT-säkerhetsfråga utan också en styrningsfråga - och passar väl in i den dokumentationsorienterade logiken i AI-lagen. (EUR-Lex) - Medvetet välja modeller och leverantörer

Kontrollera: hosting (EU/EES?), AV-avtal, lagrings- och utbildningspolicy, transparens, tekniska säkerhetsfunktioner. Vissa leverantörer annonserar nu uttryckligen „noll lagring“ och „ingen utbildning på kunddata“. (ASCOMP) - Medarbetarutbildning - också lagstadgad sedan februari 2025

Korta utbildningstillfällen, live-demonstrationer, workshops med små användningsfall - syfte: att förstå var möjligheterna finns och var de röda linjerna går.

Sedan februari 2025 har EU:s AI-lag uttryckligen krävt att företag ska säkerställa en tillräcklig nivå av AI-kompetens (AI literacy). Utbildning, interna riktlinjer och dokumenterat deltagande blir därmed i praktiken en obligatorisk del av AI-efterlevnaden - jämförbart med utbildning i dataskydd eller informationssäkerhet. - Integrera AI och dataskydd med din befintliga webb- och SEO-strategi

Den som redan är ren med Teknisk SEO, prestanda och underhåll av strukturerad data har en bra grund för rena AI-integrationer. Är du bekant med min guide till teknisk SEO och min artikel om de viktigaste SEO-trenderna 2024 - eftersom synlighet, förtroende och lagligt kompatibel teknik går hand i hand. (saskialund.de)

5. varför konsumentkonton (gratis eller grundläggande konton) från ChatGPT & Co är knepiga för företag

Även om dataskyddsinställningarna har förbättrats är användningen av klassiska konsumentkonton fortfarande problematisk i många företagssammanhang:

- Dataflöden till tredje land och komplexa underprocessorkedjor,

- begränsad eller saknas Avtal om orderhantering,

- Oklar transparens för dem som berörs,

- Delvis användning av insatsvaror till Modellutbildning (beroende på leverantör/taxa), även om många leverantörer nu erbjuder „opt-out“- eller affärsalternativ. (eRecht24)

Detta betyder inte att du inte får använda sådana verktyg, men:

- I företagssammanhang kan de ofta bara säkras ordentligt med hjälp av omfattande samordning, avtalsgranskning och ytterligare åtgärder.

- Särskilt i entreprenörssammanhang är det därför ofta värt att ta ett steg mot att dedikerade AI-plattformar, som uttryckligen är utformade för GDPR-anpassad användning.

6 AI-plattformar som uppfyller kraven på dataskydd - InnoGPT och Langdock i fokus

Det finns nu plattformar som erbjuder olika LLM i en GDPR-kompatibel miljö i EU bunt. Två av dessa är InnoGPT och Lång docka.

6.1 Vad kännetecknar InnoGPT?

Nedan följer en sammanfattning av de beskrivningar som finns tillgängliga för allmänheten:

- InnoGPT-paket ledande språkmodeller (t.ex. GPT-4, GPT-5, Gemini, Claude, Mistral etc.) i en plattform som är speciellt utformad för Tyska och europeiska företag mål. (sysbus.eu)

- Plattformen är baserad på Hosting i Europa och annonserar med en avtalsenligt säkrad „zero retention policy“, Detta innebär att kundernas uppgifter inte används för att träna AI-modellerna och att de endast behandlas på europeiska servrar - dvs. uppgifterna hamnar inte hos den ursprungliga leverantören i tredje land. (ASCOMP)

- Den uppfyller typiska företagskrav som t.ex. Teamfunktionalitet, arbetsflöden och integrering i befintliga processer.

Om du vill ta en närmare titt kan du använda följande länk:

Lär känna InnoGPT (partnerlänk)

För företag som Ersätter skugg-AI och samtidigt vill förse sina team med moderna verktyg, är detta tillvägagångssätt spännande:

Dina team fortsätter att arbeta med starka modeller - men i en kontrollerad, dokumenterbar och GDPR-vänlig miljö.

7. Praktiska exempel: Hur små och medelstora företag och industrin kan använda InnoGPT

Några scenarier som jag känner till från projekt och diskussioner med kunder:

- Teknisk försäljning och offertförberedelser

- Specialiserade texter, produktbeskrivningar och erbjudanden utarbetas via InnoGPT.

- Internt använda dokument kan integreras med hjälp av hämtningstekniker utan att företaget förlorar kontrollen över data. (arXiv)

- Kunskapshantering & dokumentation

- Interna riktlinjer, manualer och SOP:ar finns tillgängliga för frågor och svar i en säker miljö.

- Medarbetare ställer frågor som „Vilka teststeg gäller för produktlinje X?“ - InnoGPT ger svar baserat på interna dokument utan att lämna över dem till externa utbildningssystem. (arXiv)

- Marknadsföring & innehåll för B2B-webbplatser och butiker

- Utkast till innehåll för WooCommerce-butiker, produktsidor och bloggartiklar skapas, med efterföljande teknisk granskning.

- Eftersom lagring och bearbetning sker i Europa kan detta integreras mycket bättre i en befintlig strategi för dataskydd och efterlevnad än genom att använda spridda konsumentverktyg. (Kapterra)

8 Styrning och AI-strategi: från individuellt verktyg till företagslösning

Om du inte vill lämna AI i ditt företag åt slumpen behöver du mer än ett verktyg:

- Inventarieförteckning

- Vem använder redan vilka AI-verktyg till vad?

- Vilka data flödar vart?

- Definiera målbild

- Vilka användningsområden ska ha officiellt stöd (t.ex. text, kod, forskning, mötesanteckningar)?

- Hur passar AI in i din befintliga Digital strategi och SEO-strategi i?

- Konsolidera verktygslandskapet

- Istället för fem olika AI-tjänster i skuggläge: en frigjord plattform, t.ex. InnoGPT, kompletterat med tydligt definierade specialverktyg.

- Riktlinjer och processer för förankring

- AI-policy, AV-avtal, register över behandlingsaktiviteter, utbildning.

- AI-riktlinjer, rollmodell, eskalering och godkännandeprocesser.

- Övervakning och kontinuerlig justering

- Implementering av AI-lagen, nya riktlinjer från tillsynsmyndigheterna, teknisk utveckling - styrning är inte ett engångsprojekt utan en pågående process. (LFS Europa)

Varför detta är mer än „bästa praxis“:

AI-lagen kräver - gradvis under 2025-2027 - ett dokumenterat styrsystem för företag som använder AI. Utan en internt förankrad AI-styrningsstruktur (riktlinjer, utbildning, övervakning) kommer det på medellång sikt att vara mycket svårt att bevisa för tillsynsmyndigheter och affärspartners att AI används på ett kontrollerat, ansvarsfullt och kompatibelt sätt.

9:e checklistan: Göra AI i företaget redo för GDPR och AI Act

En kort Checklista, som du kan börja med redan idag:

- Gör en inventering - Var används AI redan i företaget (verktyg, datatyper, processer)?

- Utför en riskbedömning - Vilka applikationer är icke-kritiska och vilka påverkar känsliga data eller kärnprocesser?

- Kontrollera rättsliga grunder och avtal - GDPR, DPA-avtal, dataflöden, överföring till tredje land.

- Definiera gemensam plattform - t.ex. InnoGPT som en central, GDPR-kompatibel AI-lösning för team

- Anta AI-policy - begriplig, praktisk, med exempel och dos & don'ts.

- Utbildning & aktivering - Ge medarbetarna möjlighet att använda AI på ett målinriktat, ansvarsfullt och effektivt sätt - och dokumentera denna utbildning (AI literacy).

- Dokumentation & övervakning - Ta AI-lagens och GDPR:s logik på allvar: dokumentera, utvärdera, förfina. (EUR-Lex)

Källor

- Dataskyddskonferensen (DSK), Vägledning „AI och dataskydd“ (fr.o.m. 1924-05-06) - Kriterier för val och användning av AI-tillämpningar i företag och offentliga myndigheter. (Konferens om dataskydd)

- Europeiska dataskyddsstyrelsen (EDPB), „Report of the work undertaken by the ChatGPT Taskforce“ (24 maj 2024) - Första harmoniserade europeiska bedömningen av ChatGPT:s databehandlingsmetoder mot bakgrund av GDPR. (EDPB)

- Faktablad „Användning av generativ AI och dataskydd“ (universitet / dataskyddsombud, fr.o.m. 04/2024) - Praktisk guide till användning av generativ AI, särskilt ChatGPT, ur ett dataskyddsperspektiv (Dataskydd HWR Berlin)

- eRecht24, „Kan ChatGPT användas i enlighet med dataskyddsbestämmelser?“ (2025) - Klassificering av den integritetsvänliga användningen av ChatGPT, inklusive information om användning och inställningar för utbildning. (eRecht24)

- Förordning (EU) 2024/1689 - Lag om artificiell intelligens (AI-lagen) - EU:s officiella rättsliga ramverk för AI, inklusive ett riskbaserat tillvägagångssätt, styrningsskyldigheter och en tidslinje för tillämpningen. (EUR-Lex)

- EU AI Act Service Desk & FPF Tidslinje - Översikt över den stegvisa tillämpningen av AI-lagen fram till 2026/2027 (AI Act Service Desk)

- Reuters & Le Monde (2025), Rapporter om EU-kommissionens förslag om att förlänga AI-lagens högriskkrav över tid - Indikationer på planerad fördröjning av vissa förordningar till 2027 (Reuters)

- Handelsblatt Live, „AI och dataskydd: Hur man använder AI-system i enlighet med GDPR“ (2025) - Klassificering av samspelet mellan GDPR, BDSG och AI Act i företagssammanhang. (Handelsblatt Live)

- ASCOMP, sysbus.eu, Capterra - Information om InnoGPT som en GDPR-kompatibel AI-plattform med EU-värd och noll lagring. (ASCOMP, sysbus.eu, Capterra)

- arXiv - Artiklar om hämtningsbaserade AI-tillämpningar och scenarier för kunskapshantering i företagssammanhang. (arXiv)

- AKEuropa - Analyser och bakgrundsrapporter om det praktiska genomförandet av AI-lagen i Europa. (AKEuropa)

Obs! Denna artikel ger teknisk vägledning om användning av AI-system i enlighet med GDPR och AI-lagen. Den ersätter inte juridisk rådgivning. För bindande bedömningar bör du konsultera juridisk expertis.

0 kommentarer