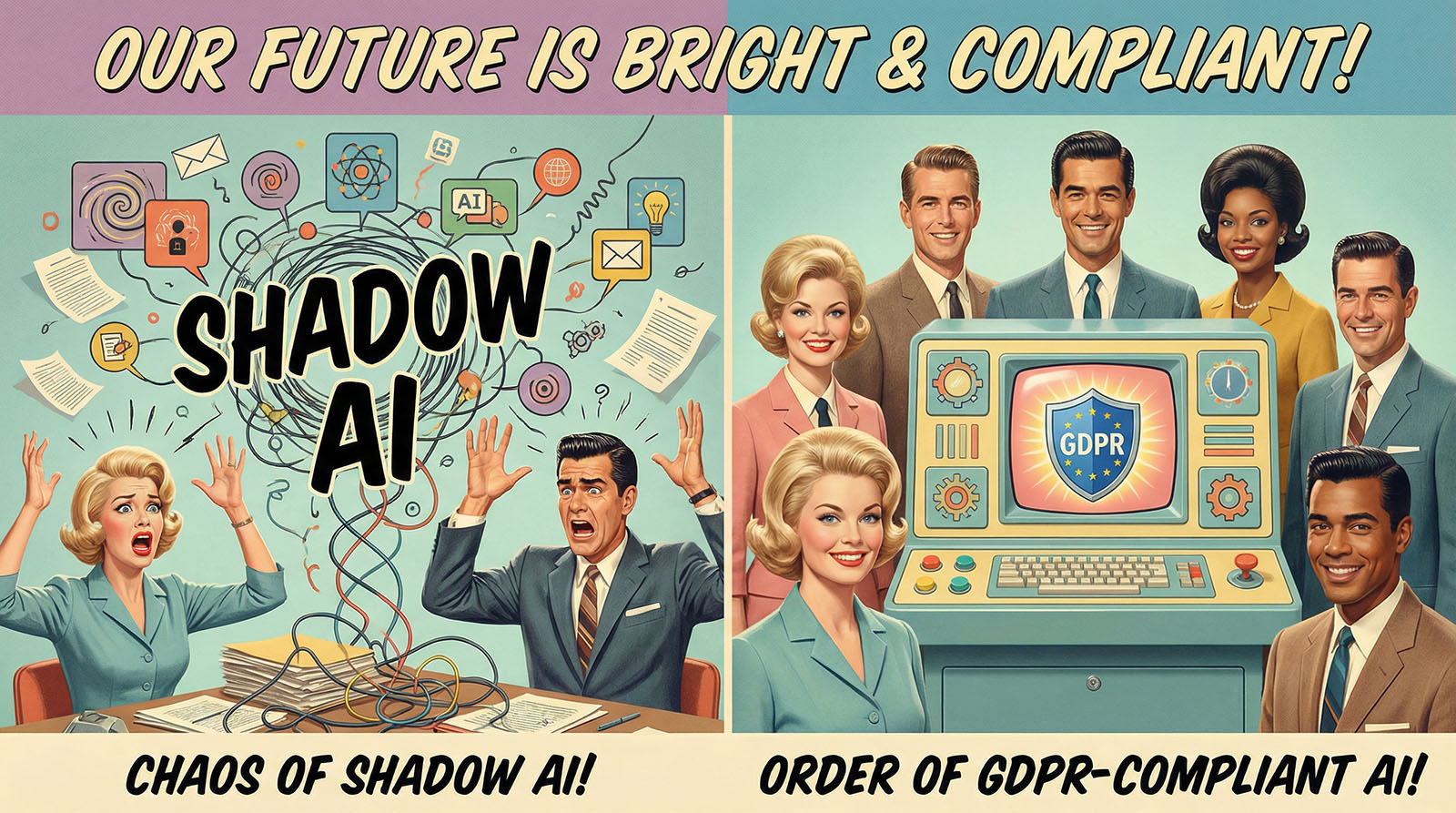

Es muy probable que alguien en su empresa ya esté utilizando la IA, sin ninguna directriz, autorización o contrato AV.

En marketing, los textos se pulen con ChatGPT; en ventas, los datos de los clientes terminan en prompts; en desarrollo, el código se verifica con herramientas de IA. Bienintencionado, pero desde el punto de vista de RGPD, Reglamento de la UE sobre IA y cumplimiento normativo empresarial Es una bomba de relojería: la IA en la sombra.

Al mismo tiempo, sería absurdo renunciar a las ganancias de productividad de los modernos Modelos de lenguaje grandes (LLM) renunciar. El arte consiste en, IA y protección de datos reunir, con un marco claro que permita la innovación y limite los riesgos.

En Experta certificada en IA (certificado de la MMAI® Business School, Academy4AI) y futura miembro de la Asociación Federal Alemana de IA. Acompaño a las empresas precisamente en esta intersección entre tecnología, derecho y gobernanza, y como Especialista en WooCommerce y desarrolladora de WordPress para pymes e industria Conozco muy bien la perspectiva práctica de los proyectos.

Este artículo trata sobre:

- como el RGPD y Reglamento de la UE sobre IA (AI Act) interactuar,

- ¿Qué riesgos son realmente relevantes al utilizar ChatGPT, Claude, Gemini y similares?,

- cuáles Normas prácticas para un uso de la IA respetuoso con la protección de datos deberían introducir,

- ¿Y por qué una plataforma como InnoGPT es una opción interesante si desea ofrecer a sus equipos una Entorno de IA conforme con el RGPD desea proporcionar.

En este artículo comparto mi perspectiva profesional como experta certificada en IA. Sin embargo, este artículo no sustituye el asesoramiento jurídico individual. Si necesita una evaluación vinculante en materia de protección de datos, le recomiendo que consulte a un abogado cualificado o a un delegado de protección de datos.

1. El marco jurídico vinculante para 2025: RGPD + Reglamento de la UE sobre IA (AI Act)

1.1 El RGPD sigue siendo la base para todos los datos personales.

Tan pronto como usted datos personales Al introducir datos en sistemas de IA, ya sea para formación, respuesta a consultas o análisis, se aplica el RGPD. Entre otras cosas, debe:

- una base jurídica de conformidad con el artículo 6 del RGPD,

- transparencia garantizar a las personas afectadas,

- Minimización de datos tener en cuenta,

- Implementar medidas técnicas y organizativas (TOM).,

- y, si procede,. Evaluaciones de impacto relativas a la protección de datos (DSFA) Realizar. (Handelsblatt en directo)

La Conferencia Alemana de Protección de Datos (DSK) ha elaborado en 2024 un informe detallado Guía orientativa „IA y protección de datos“ . En él se deja claro que quien selecciona y utiliza aplicaciones de IA es responsable de que dicha selección se realice de conformidad con la normativa de protección de datos, lo que incluye la elección del proveedor, los flujos de datos y la configuración. (Conferencia sobre protección de datos)

El EDPB (Comité Europeo de Protección de Datos) tiene con su Grupo de trabajo ChatGPT Además, se abordan cuestiones concretas sobre la legalidad del web scraping, la transparencia y los requisitos de veracidad en los LLM. (EDPB)

En resumen: aunque la IA sea nueva, En lo que respecta a la protección de datos, no es un espacio sin legislación..

1.2 Reglamento de la UE sobre IA (AI Act): basado en el riesgo e impulsado por la gobernanza

Con la Reglamento de la UE sobre IA (Reglamento (UE) 2024/1689) En 2024, la UE aprobó el primer marco jurídico integral del mundo para los sistemas de IA. La Ley de IA está en vigor desde 1 de agosto de 2024 en vigor y establece un enfoque basado en el riesgo: desde el riesgo mínimo hasta el riesgo limitado y el IA de alto riesgo y prácticas prohibidas. (EUR-Lex)

Puntos importantes:

- Algunos Prohibición de determinadas prácticas de IA (por ejemplo, determinadas formas de sistemas manipuladores) y requisitos para Competencia en IA / Alfabetización en IA ya están vigentes desde 2 de febrero de 2025. (Ley de inteligencia artificial de la UE)

- La mayor parte de las obligaciones, especialmente para IA de alto riesgo – se introducirá gradualmente hasta 2 de agosto de 2026 Eficaz, con más detalles y directrices por parte de la Comisión Europea y el nuevo Oficina Europea de IA. (Servicio de asistencia técnica de la Ley de IA)

- La Ley de IA establece, entre otras cosas, requisitos relativos a Gestión de riesgos, calidad de los datos, registro, documentación técnica, transparencia, supervisión humana y estructuras de gobernanza.. (EUR-Lex)

Actualmente, la UE está debatiendo, Ampliar determinadas obligaciones para la IA de alto riesgo hasta 2027., para dar a las empresas más tiempo para la implementación. A día de hoy (11 de diciembre de 2025), se trata de una propuesta política que aún debe pasar por el proceso legislativo. (Reuters)

Importante para usted:

El RGPD sigue siendo plenamente aplicable., la Ley de IA la complementa. En caso de duda, se aplica lo siguiente:

„La Ley de IA regula qué lo que puede hacer un sistema de IA: el RGPD regula, como Puede manejar datos personales“. (Handelsblatt en directo)

1.3 Alfabetización en IA y obligaciones de gobernanza: por qué las empresas necesitan demostrar competencias en IA desde 2025

El Reglamento de la UE sobre IA establece por primera vez un marco claro para la Responsabilidad organizativa de las empresas, que utilizan sistemas de IA, independientemente de si desarrollan sus propios modelos o utilizan herramientas externas.

Desde 2025 hay dos puntos que revisten especial importancia:

Obligación de alfabetización en IA (art. 4 de la Ley de IA): aplicable desde febrero de 2025.

Las empresas que proporcionan o utilizan sistemas de IA („proveedores“ y, sobre todo, „implementadores“) deben garantizar que sus empleados tengan un Nivel suficiente de competencia en IA poseer. En la práctica, esto significa:

- Los empleados deben comprender cómo funciona básicamente la IA, dónde residen los riesgos y cómo trabajar con ella de forma segura.

- Las empresas deben proporcionar formación, medidas de sensibilización y directrices internas.

- Estas medidas deben documentarse de manera que puedan demostrarse en el marco de la obligación de rendir cuentas.

En otras palabras:

„Desde febrero de 2025, “utilizar la IA„ va indisolublemente unido a “demostrar competencia en IA».

Gobernanza de la IA: relevante para la IA de uso general desde agosto de 2025

Con la entrada en vigor de la normativa sobre IA de uso general (GPAI) en agosto de 2025, se aplicarán requisitos organizativos adicionales, especialmente para los proveedores, pero también, de forma indirecta, para las empresas que utilicen dichos sistemas de forma productiva:

- Documentación estructurada de los modelos utilizados.,

- Supervisión y registro del uso,

- Procesos para la gestión de incidentes, riesgos y reclamaciones.,

- Funciones y responsabilidades claras en el uso de la IA.

Aunque el conjunto completo de obligaciones para la IA de alto riesgo no entrará en vigor hasta 2026/2027, una cosa está clara:

Sin un concepto de gobernanza de la IA, es decir, sin responsabilidades, directrices, procesos y formaciones documentados, a las empresas les resultará cada vez más difícil demostrar de forma creíble que su uso cumple con la Ley de IA y el RGPD.

2. Lo que dicen concretamente las autoridades reguladoras sobre la IA y los LLM

Para que resulte más comprensible, echemos un vistazo a tres fuentes fundamentales:

- Guía orientativa de la DSK „IA y protección de datos“ (2024) – Proporciona a las empresas y a las autoridades criterios sobre cómo seleccionar y utilizar los sistemas de IA: finalidad, base jurídica, minimización de datos, transparencia, tratamiento de encargos, medidas técnicas y organizativas. (Conferencia sobre protección de datos)

- Informe del grupo de trabajo ChatGPT del EDPB (mayo de 2024) – destaca, entre otras cosas:

- cómo se debe evaluar jurídicamente la formación sobre el rastreo web de datos personales,

- ¿Qué obligaciones de transparencia e información existen frente a los usuarios?,

- los requisitos de veracidad y equidad que se exigen a las respuestas LLM. (EDPB)

- Fichas técnicas nacionales, p. ej., HWR Berlín / Delegado de protección de datos – muestran de forma muy concreta qué datos se generan al utilizar la IA generativa y cómo se puede diseñar su uso de forma que respete la protección de datos (por ejemplo, sin identificadores directos, con seudonimización, sin datos sensibles en herramientas de libre acceso). (Protección de datos HWR Berlín)

El mensaje es similar en todas partes:

- Principio: introducir la menor cantidad posible de datos personales en los sistemas de IA.

- Las empresas necesitan reglas claras, qué herramientas se pueden utilizar y cómo.

- „Solo probarlo rápidamente“ no es un motivo legal válido.

3. Riesgos típicos: cómo surge la IA en la sombra en la empresa

Algunas situaciones típicas que veo una y otra vez:

- El departamento de marketing carga los datos de los clientes (por ejemplo, exportación de CRM) en cualquier aplicación web de IA para „crear segmentos rápidamente“.

- El departamento de RR. HH. somete los contratos de trabajo o las solicitudes de empleo a la evaluación de ChatGPT, incluyendo todos los datos personales.

- El departamento de ventas copia historiales completos de correos electrónicos con información personal en LLM para formular „mejores respuestas“.

- Los departamentos especializados utilizan herramientas LLM gratuitas sin cuenta empresarial, sin contrato AV y sin saber dónde se procesan los datos.

Desde el punto de vista de la protección de datos, esto plantea varios problemas:

- sin resolver Funciones y responsabilidades (Controlador / Procesador),

- posible Transferencias a terceros países (por ejemplo, EE. UU.),

- poco claro Almacenamiento y uso de los datos para entrenamientos,

- ausente o insuficiente Información a los afectados.

Precisamente estos casos han sido objeto de una mayor atención por parte de las autoridades de control de la protección de datos en los últimos meses, lo que ha dado lugar a restricciones a corto plazo y a inspecciones de determinados proveedores. (StreamLex)

4. 10 reglas básicas: uso de los LLM respetuoso con la protección de datos (en solitario y en equipo)

Ya seas un empresario individual o una pyme dedicada a las tecnologías de la información, las siguientes reglas te resultarán muy útiles en la práctica para LLM compatibles con el RGPD utilizar:

- No hay datos personales sensibles en las cuentas de consumidores.

Los datos sanitarios, las categorías especiales según el artículo 9 del RGPD, la información confidencial de los empleados, los contratos internos, etc. no tienen cabida en interfaces de IA de libre acceso. (Protección de datos HWR Berlín) - Pseudonimizar o anonimizar siempre que sea posible

En lugar de „Juan Pérez, IBAN, proyecto XY con el cliente Z“, es mejor: „Cliente A, presupuesto B, proyecto en el ámbito de la ingeniería mecánica, país de exportación D“. - Estrategia clara en cuanto a herramientas: separar lo privado de lo profesional

No basta con decir „utilizaré mi cuenta privada de ChatGPT“. Defina las herramientas autorizadas y, en caso de duda, bloquee los dominios problemáticos en el proxy de la empresa. (Base de datos regional de Renania del Norte-Westfalia) - Crear una política propia de la empresa („Política de IA“)

Breve, comprensible, práctico: ¿qué herramientas están permitidas? ¿Qué datos se pueden introducir? ¿Quién es la persona de contacto para cualquier pregunta? Hoy en día, una directriz sobre IA ya no es algo „que estaría bien tener“, sino un elemento central de la gobernanza de la IA. - Aclarar la base jurídica

En la empresa, a menudo se basará en intereses legítimos (art. 6, apartado 1, letra f) del RGPD), el cumplimiento de un contrato o, en su caso, el consentimiento. Es importante llevar una documentación clara en el Registro de actividades de tratamiento. (Conferencia sobre protección de datos) - Comprobar DSFA, especialmente en escenarios sensibles.

Cuando los sistemas de IA intervienen de forma masiva en los procesos empresariales o contienen elementos de perfilado, se produce una Evaluación del impacto en la protección de datos A menudo obligatorio. (Conferencia sobre protección de datos) - Registrar y hacer comprensible

¿Quién utiliza qué sistema y para qué? El registro no es solo una cuestión de seguridad informática, sino también de gobernanza, y encaja bien con la lógica orientada a la documentación de la Ley de IA. (EUR-Lex) - Seleccionar modelos y proveedores de forma consciente

Compruebe: alojamiento (¿UE/EEE?), contrato AV, política de almacenamiento y formación, transparencia, características técnicas de seguridad. Algunos proveedores anuncian explícitamente „retención cero“ y „sin formación sobre los datos de los clientes“. (ASCOMP) - Formar a los empleados: desde febrero de 2025 también será una obligación legal

Cursos breves, demostraciones en directo, pequeños talleres sobre casos prácticos: el objetivo es comprender dónde están las oportunidades y dónde están los límites.

Desde febrero de 2025, el Reglamento de la UE sobre IA (EU AI Act) exige expresamente que las empresas garanticen un nivel suficiente de competencia en materia de IA (AI Literacy). De este modo, la formación, las directrices internas y la participación documentada se convierten de hecho en un componente obligatorio del cumplimiento de la normativa sobre IA, comparable a la formación en materia de protección de datos o seguridad de la información. - Integre la IA y la protección de datos en su estrategia web y SEO actual.

Quien ya haya limpiado con SEO técnico, rendimiento y mantenimiento estructurado de datos trabaja, tiene una buena base para integraciones limpias de IA. ¿Conoce mi guía sobre SEO técnico así como mi artículo sobre los Las tendencias SEO más importantes para 2024 – porque la visibilidad, la confianza y las tecnologías seguras desde el punto de vista jurídico están interrelacionadas. (saskialund.de)

5. Por qué las cuentas de consumidor (cuentas gratuitas o básicas) de ChatGPT & Co son delicadas para las empresas

Incluso con las mejoras en la configuración de la protección de datos, el uso de cuentas de consumidor clásicas sigue siendo problemático en muchos contextos empresariales:

- Flujos de datos hacia terceros países y cadenas complejas de subprocesadores,

- limitado o inexistente Contratos de procesamiento de pedidos,

- Transparencia poco clara para los afectados.,

- Uso parcial de las entradas para el Entrenamiento de modelos (dependiendo del proveedor/tarifa), aunque muchos proveedores ofrecen ahora opciones de „exclusión voluntaria“ u opciones empresariales. (eRecht24)

Esto no significa que no pueda utilizar este tipo de herramientas, pero:

- En el contexto empresarial A menudo, solo pueden garantizarse de forma adecuada con un considerable esfuerzo de coordinación, revisión de contratos y medidas adicionales.

- Por lo tanto, especialmente en el contexto empresarial, a menudo vale la pena dar un paso hacia Plataformas dedicadas de IA, que están diseñados explícitamente para un uso conforme con el RGPD.

6. Plataformas de IA que cumplen con la normativa de protección de datos: InnoGPT y Langdock en el punto de mira

Actualmente existen plataformas que ofrecen diferentes LLM en un entorno alojado en la UE y orientado al RGPD agrupar. Dos de ellos son InnoGPT y muelle largo.

6.1 ¿Qué caracteriza a InnoGPT?

De las descripciones disponibles públicamente se desprende, en resumen, lo siguiente:

- InnoGPT agrupa modelos lingüísticos líderes (por ejemplo, GPT-4, GPT-5, Gemini, Claude, Mistral, etc.) en una plataforma especialmente diseñada para empresas alemanas y europeas apunta. (sysbus.eu)

- La plataforma apuesta por Alojamiento en Europa y se anuncia con una „Política de retención cero“ garantizada contractualmente“, es decir, los datos introducidos por los clientes no se utilizan para entrenar los modelos de IA y se procesan exclusivamente en servidores europeos, por lo que los datos no llegan al proveedor original de terceros países. (ASCOMP)

- Aborda requisitos empresariales típicos como Funcionalidades de equipo, flujos de trabajo e integración en procesos existentes.

Si desea verlo en concreto, utilice el siguiente enlace:

Conozca InnoGPT (Enlace de afiliado)

Para empresas que Reemplazar IA sombra y, al mismo tiempo, desean proporcionar a sus equipos herramientas modernas, este enfoque resulta especialmente interesante:

Sus equipos siguen trabajando con modelos sólidos, pero en una entorno controlado, documentable y compatible con el RGPD.

7. Ejemplos prácticos: cómo las pymes y la industria podrían utilizar InnoGPT

Algunos escenarios que conozco por proyectos y conversaciones con clientes:

- Ventas técnicas y elaboración de ofertas

- Los textos técnicos, las descripciones de productos y las ofertas se preparan mediante InnoGPT.

- Los documentos de uso interno pueden integrarse mediante técnicas de recuperación sin que la empresa pierda el control sobre los datos. (arXiv)

- Gestión del conocimiento y documentación

- Las directrices internas, los manuales y los procedimientos operativos estándar (SOP) se ponen a disposición para preguntas y respuestas en un entorno seguro.

- Los empleados plantean preguntas como „¿Qué pasos de verificación se aplican a la línea de productos X?“. InnoGPT proporciona respuestas basadas en documentos internos, sin transferirlos a sistemas de formación externos. (arXiv)

- Marketing y contenido para sitios web y tiendas B2B

- Borradores de contenido para Tiendas WooCommerce, páginas de productos y artículos de blog Se elaboran y se someten a una revisión técnica posterior.

- Debido al almacenamiento y procesamiento en Europa, se integra mucho mejor en una estrategia de protección de datos y cumplimiento normativo existente que el uso de herramientas de consumo dispersas. (Capterra)

8. Gobernanza y estrategia de IA: de herramienta individual a solución empresarial

Si no desea dejar la IA en su empresa al azar, necesitará algo más que una herramienta:

- inventario

- ¿Quién utiliza ya qué herramientas de IA y para qué?

- ¿Qué datos se transmiten y adónde?

- Definir el objetivo

- ¿Qué casos de uso se deben admitir oficialmente (por ejemplo, texto, código, investigación, notas de reuniones)?

- ¿Cómo encaja la IA en su actual Estrategia digital y SEO ¿Uno?

- Consolidar el panorama de herramientas

- En lugar de cinco servicios de IA diferentes en funcionamiento en segundo plano: una plataforma compartida, por ejemplo, InnoGPT, complementado con herramientas especiales claramente definidas.

- Establecer directrices y procesos

- Política de IA, contratos AV, registro de actividades de tratamiento, formación.

- Directiva sobre IA, modelo de roles, procesos de escalamiento y autorización.

- Seguimiento y adaptación continua

- Aplicación de la Ley de IA, nuevas directrices de las autoridades supervisoras, avances técnicos: la gobernanza no es un proyecto puntual, sino un proceso continuo. (AKEuropa)

Por qué es más que una „buena práctica“:

La Ley de IA exige, de forma gradual entre 2025 y 2027, un sistema de gobernanza documentado para las empresas que utilizan IA. Sin una estructura de gobernanza de IA integrada internamente (directrices, formación, supervisión), a medio plazo será muy difícil demostrar a las autoridades reguladoras y a los socios comerciales que el uso de la IA se realiza de forma controlada, responsable y conforme a la normativa.

9. Lista de verificación: preparar la IA en la empresa para el RGPD y la Ley de IA

Una breve lista de comprobación, con la que puede empezar hoy mismo:

- Hacer inventario – ¿En qué ámbitos de la empresa se utiliza ya la IA (herramientas, tipos de datos, procesos)?

- Realizar una evaluación de riesgos ¿Qué operaciones no son críticas y cuáles afectan a datos sensibles o procesos fundamentales?

- Revisar los fundamentos jurídicos y los contratos – RGPD, contratos AV, flujos de datos, transferencias a terceros países.

- Definir plataforma autorizada – p. ej. InnoGPT como solución centralizada de IA para equipos, conforme al RGPD

- Aprobar la política de IA – Comprensible, práctico, con ejemplos y consejos sobre lo que se debe y no se debe hacer.

- Formación y capacitación – Capacitar a los empleados para que utilicen la IA de forma específica, responsable y eficiente, y documentar esta formación (alfabetización en IA).

- Documentación y supervisión – Tomarse en serio la lógica de la Ley de IA y el RGPD: documentar, evaluar, perfeccionar. (EUR-Lex)

Fuentes

- Conferencia sobre Protección de Datos (DSK), guía orientativa „IA y protección de datos“ (versión del 06/05/2024) – Criterios para la selección y el uso de aplicaciones de IA en empresas y organismos públicos. (Conferencia sobre protección de datos)

- Comité Europeo de Protección de Datos (CEPD), „Informe sobre el trabajo realizado por el grupo de trabajo ChatGPT“ (24 de mayo de 2024). – Primera evaluación europea coordinada de las prácticas de tratamiento de datos de ChatGPT a la luz del RGPD. (EDPB)

- Ficha informativa „Uso de la IA generativa y protección de datos“ (Universidad / Delegado de protección de datos, versión 04/2024) – Guía práctica para el uso de la IA generativa, en particular ChatGPT, desde el punto de vista de la protección de datos. (Protección de datos HWR Berlín)

- eRecht24, „¿Se puede utilizar ChatGPT de conformidad con la normativa de protección de datos?“ (2025) – Clasificación para un uso de ChatGPT respetuoso con la protección de datos, incluyendo indicaciones sobre el uso de la formación y la configuración. (eRecht24)

- Reglamento (UE) 2024/1689 – Ley de Inteligencia Artificial (Ley de IA) – Marco jurídico oficial de la UE para la IA, que incluye, entre otras cosas, un enfoque basado en el riesgo, obligaciones de gobernanza y un calendario de aplicación. (EUR-Lex)

- Servicio de asistencia de la Ley de IA de la UE y calendario de la FPF – Resumen de la aplicación gradual de la Ley de IA hasta 2026/2027. (Servicio de asistencia técnica de la Ley de IA)

- Reuters y Le Monde (2025), informes sobre las propuestas de la Comisión Europea para aplazar las obligaciones de alto riesgo de la Ley de IA. – Indicaciones sobre el retraso previsto de determinadas regulaciones hasta 2027. (Reuters)

- Handelsblatt Live, „IA y protección de datos: cómo utilizar los sistemas de IA de conformidad con el RGPD“ (2025) – Clasificación de la interacción entre el RGPD, la BDSG y la Ley de IA en el contexto empresarial. (Handelsblatt en directo)

- ASCOMP, sysbus.eu, Capterra: información sobre InnoGPT como plataforma de IA orientada al RGPD con alojamiento en la UE y enfoque de retención cero. (ASCOMP, sysbus.eu, Capterra)

- arXiv: artículos especializados sobre aplicaciones de IA basadas en la recuperación y escenarios de gestión del conocimiento en el contexto empresarial. (arXiv)

- AKEuropa: análisis e informes de fondo sobre la aplicación práctica de la Ley de IA en Europa. (AKEuropa)

Nota: Este artículo ofrece orientación técnica sobre el uso de sistemas de IA conforme al RGPD y la Ley de IA. No sustituye al asesoramiento jurídico. Para obtener evaluaciones vinculantes, debe consultar a un experto jurídico.

0 comentarios